中山大学陈洪波教授团队发布用于协作 SLAM 的大规模多模态数据集

多机器人协作在搜索救援、工业自动化、智慧农业等领域发展迅猛,而协同 SLAM(C-SLAM) 是实现多机器人协作的核心技术。现有的 EuRoc、KITTI 等数据集虽然在单机 SLAM 领域发挥了重要作用,但却很难去评价多机协同的轨迹和建图精度。陈洪波教授团队发布了一个用于协作 SLAM 的大规模多模态数据集,由 3 个无人车沿四种轨迹采集,包含 7 个室外场景和 5 个室内场景。

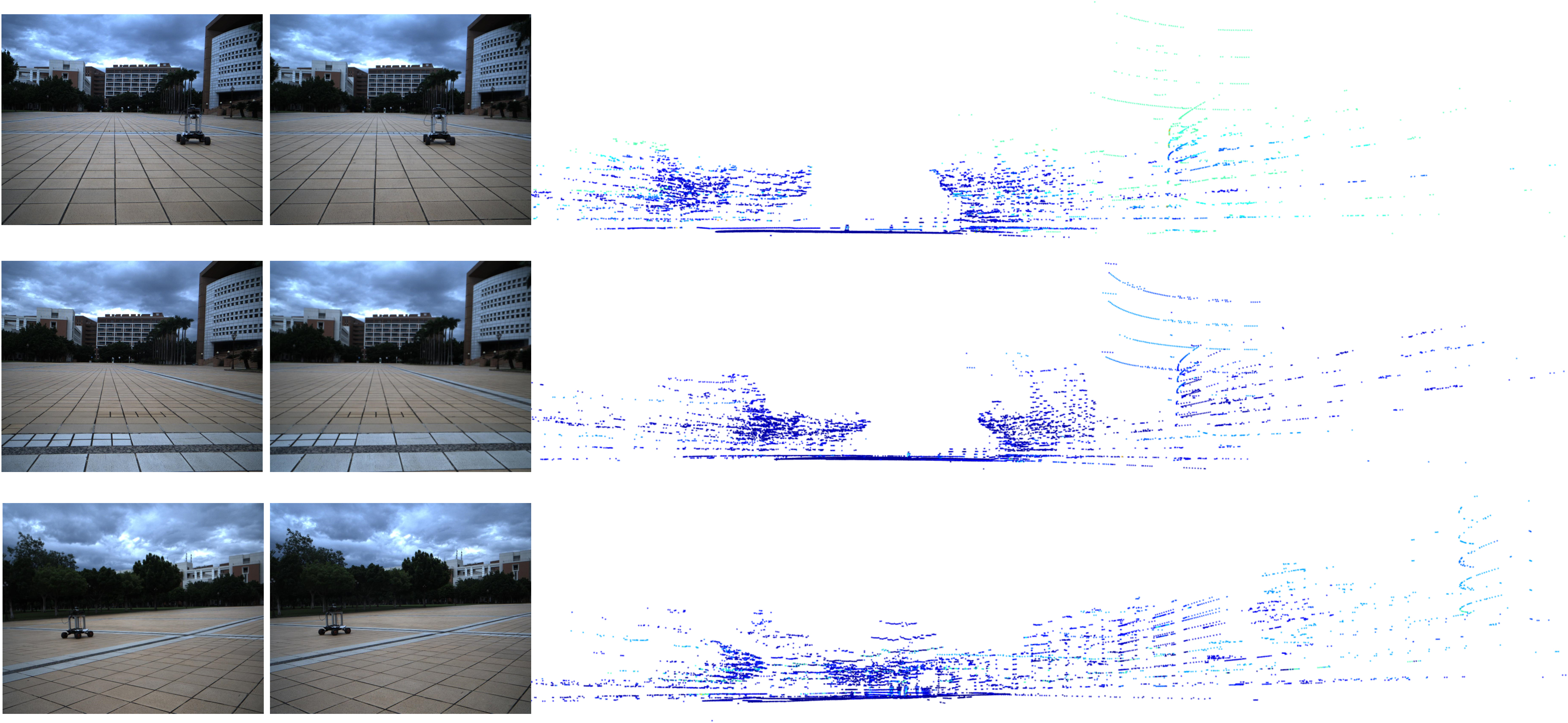

如图1所示是用于采集 S3E 数据集的无人车,每个无人车上都有 2 个高分辨率彩色相机、1 个 16 线激光雷达、1 个 9 轴 IMU 以及 1 个双天线 RTK。

Figure 1: 采集平台,三个遥控车辆分别名为 Alpha, Bob 以及 Carol。

无人车所使用的平台是 Agilex Scout Mini,它是一款四轮驱动、最高车速 10km/h 的全地形高速遥控移动平台。在具体的数据采集过程中,使用 Velodyne VLP-16 Puck 来记录 360° 点云数据。使用两台 HikRobot MV-CS050-10GC GigE 相机采集双目视觉数据,其中双目相机的基线为 360mm,图像通过全局快门扫描捕获,并从原始图像降采样到 1224x1024。此外,还使用 9 轴 Xsens MTi30-2A8G4 IMU 记录三个加速度计和三个陀螺仪。为了进行验证和测试,还使用 Femtomes Nano-D RTK 配备双天线在 GNSS 可用区域捕获轨迹真值,真值采集频率为 1 Hz。采集到的 S3E 数据集样例如图2所示。

Figure 2: S3E 数据集的数据示例,每行都显示了不同平台同时捕捉到的双目图像和点云。

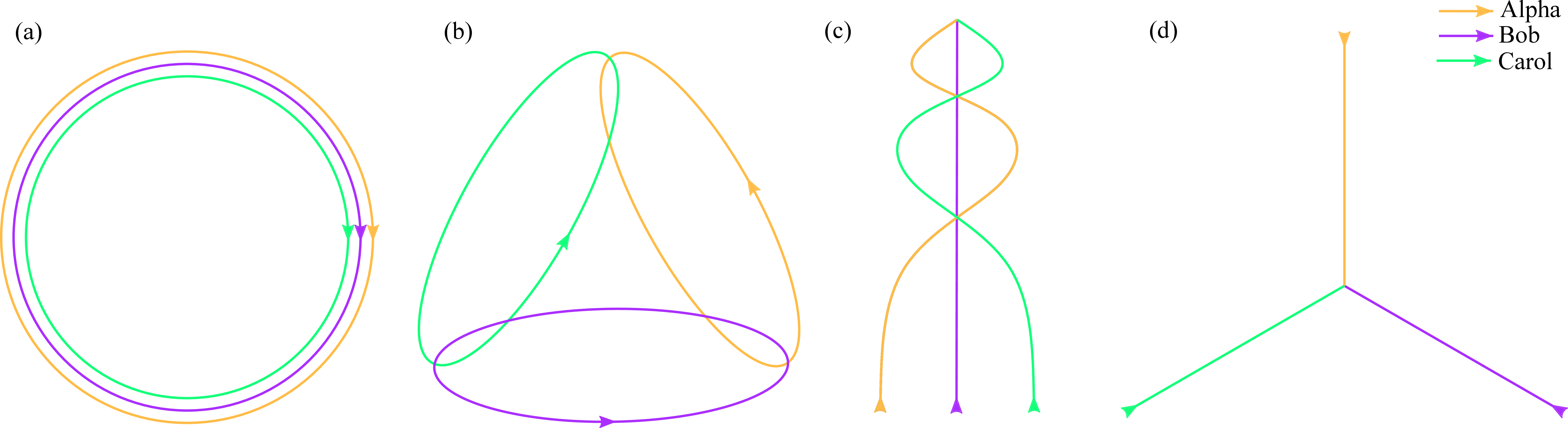

如图3所示,在 S3E 数据集中,团队设计了遵循四种不同的机器人内/机器人间规范的闭环轨迹。 第一范式是 C-SLAM 应用中的典型情况,即机器人编队同时绕目标运行,主要用于对目标进行稠密三维重建。第二范式模拟区域搜索和救援任务,每个机器人在不同的区域搜索,并在交互过程中与其他机器人共享信息。这种情况要求 C-SLAM 算法在小的公共区域内具有可靠的机器人内部闭环能力和高效的机器人之间闭环能力。第三范式集中于仅具有机器人间环路闭合的场景,所有的机器人都从不同的地方开始,并在路径中的一些会合点前进,最后在同一个地方相遇。第四范式中,机器人从不同的地方开始,终点是同一个地点,这种情况在 C-SLAM 中非常困难,因为所有的机器人只在终点相遇,几乎没有为回环提供任何信息。

Figure 3: 四种轨迹范例。

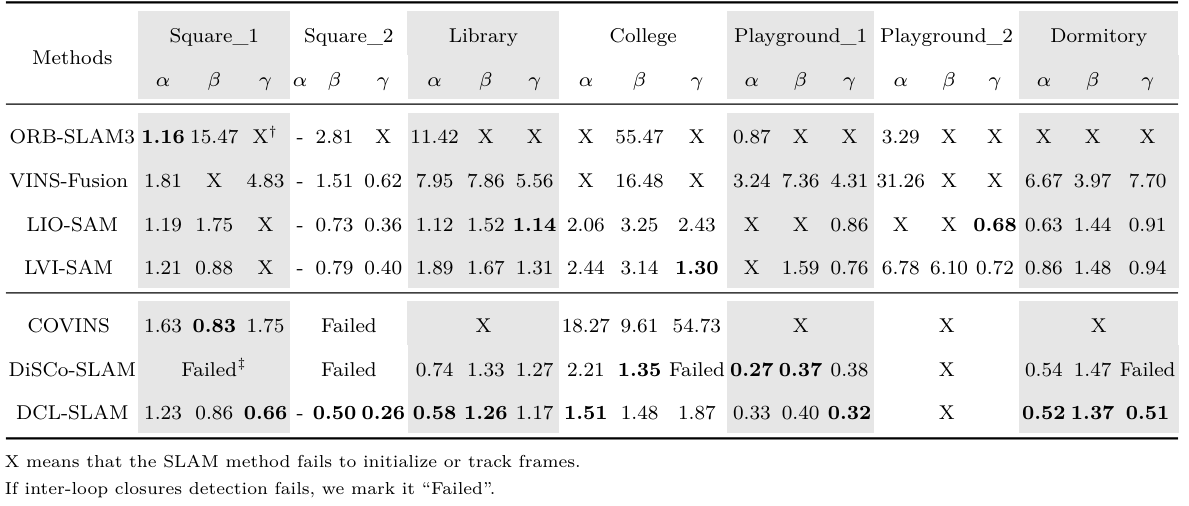

如表1所示,团队在 S3E 数据集上提供了四个单机器人 SLAM 和三个 C-SLAM 基线,评价指标为 ATE,均是目前的主流 SLAM 算法。其中前者包括 ORB-SLAM3、VINS-Fusion、LIO-SAM 以及 LVI-SAM。后者包括 COVINS、DiSCo-SLAM 以及 DCL-SLAM。

Table 1: 室外环境下单 SLAM 和 C-SLAM 的基准 ATE。

目前,团队已经公开数据下载连接://github.com/PengYu-Team/S3E。 论文连接://arxiv.org/abs/2210.13723。

编辑:戚煜华

初审:袁婷

复审:庄学彬

终审:陈洪波